|

юБРНюБРНЛЮРХГЮЖХЪюПУХРЕЙРСПЮюЯРПНМНЛХЪюСДХРаХНКНЦХЪаСУЦЮКРЕПХЪбНЕММНЕ ДЕКНцЕМЕРХЙЮцЕНЦПЮТХЪцЕНКНЦХЪцНЯСДЮПЯРБНдНЛдПСЦНЕфСПМЮКХЯРХЙЮ Х ялххГНАПЕРЮРЕКЭЯРБНхМНЯРПЮММШЕ ЪГШЙХхМТНПЛЮРХЙЮхЯЙСЯЯРБНхЯРНПХЪйНЛОЭЧРЕПШйСКХМЮПХЪйСКЭРСПЮкЕЙЯХЙНКНЦХЪкХРЕПЮРСПЮкНЦХЙЮлЮПЙЕРХМЦлЮРЕЛЮРХЙЮлЮЬХМНЯРПНЕМХЕлЕДХЖХМЮлЕМЕДФЛЕМРлЕРЮККШ Х яБЮПЙЮлЕУЮМХЙЮлСГШЙЮмЮЯЕКЕМХЕнАПЮГНБЮМХЕнУПЮМЮ АЕГНОЮЯМНЯРХ ФХГМХнУПЮМЮ рПСДЮоЕДЮЦНЦХЙЮоНКХРХЙЮоПЮБНоПХАНПНЯРПНЕМХЕоПНЦПЮЛЛХПНБЮМХЕоПНХГБНДЯРБНоПНЛШЬКЕММНЯРЭоЯХУНКНЦХЪпЮДХНпЕЦХКХЪяБЪГЭяНЖХНКНЦХЪяОНПРяРЮМДЮПРХГЮЖХЪяРПНХРЕКЭЯРБНрЕУМНКНЦХХрНПЦНБКЪрСПХГЛтХГХЙЮтХГХНКНЦХЪтХКНЯНТХЪтХМЮМЯШуХЛХЪуНГЪИЯРБНжЕММННАПЮГНБЮМХЕвЕПВЕМХЕщЙНКНЦХЪщЙНМНЛЕРПХЙЮщЙНМНЛХЙЮщКЕЙРПНМХЙЮчПХЯОСМДЕМЙЖХЪ

йБЮДПЮРХВМШЕ ТСМЙЖХХ Х ЯНОПЪФЕММШЕ МЮОПЮБКЕМХЪ

бЮґФґМНИ ХДЕґЕИ, ЙНґРНґПЮЪ ОПХґБЕґКЮ Й ПЮГґПЮґАНРґЙЕ ЛЕґРНґДНБ Я БШґЯНґЙНИ (ОНВРХ МЭЧґРНґМНБґЯЙНИ) ЯЙНґПНґЯРЭЧ ЯУНґДХґЛНґЯРХ АЕГ БШВХЯґКЕґМХЪ БРНґПШУ ОПНґХГґБНДґМШУ, НЙЮґГЮґКНЯЭ ХЯґОНКЭґГНґБЮґМХЕ БГЮґХЛґМН ЯНґОПЪґФЕМґМШУ МЮґОПЮґБґКЕґМХИ ОНґХЯґЙЮ ЛХґМХґЛСґЛЮ. бМЮВЮКЕ ЛШ ПЮЯґЯЛНґРґПХЛ ЩРНР ОНДґУНД ОПХґЛЕґМХґРЕКЭґМН Й ЛХґМХґЛХґГЮґЖХХ ЙБЮґДґПЮґРХВМШУ ТСМЙґЖХИ, ОНґЯЙНКЭґЙС ОНґКСґВЕМґМШЕ ГДЕЯЭ ПЕґГСКЭґРЮґРШ ДЮґЧР ЯРПНґЦНЕ РЕґНґПЕґРХВЕЯґЙНЕ НАНґЯґМНґБЮґМХЕ ЛЕґРНґДЮ ЯНґОПЪґФЕМґМШУ МЮґОПЮґБґКЕґМХИ.

дБЮ БЕґЙґРНґПЮ u Х v Б N-ЛЕПґМНЛ ОПНґЯРПЮМґЯґРґБЕ МЮґГШґБЮґЧРґЯЪ ЯНґОПЪґФЕМґМШґЛХ НРґМНґЯХґРЕКЭґМН ЯХЛґЛЕРґПХВМНИ ОНґКНґФХґРЕКЭґМН НОґПЕґДЕґКЕМґМНИ ЛЮґРґПХґЖШ A, ЕЯґКХ ХЛЕґЕР ЛЕґЯґРН ЯНґНРґМНґЬЕґМХЕ

. (13)

. (13)

кЕЦґЙН ОНґЙЮґГЮРЭ, ВРН ЕЯґКХ Б N-ЛЕПґМНЛ ОПНґЯРПЮМґЯґРґБЕ МЮИґДЕґМН N БГЮґХЛґМН ЯНґОПЪґФЕМґМШУ (НРґМНґЯХґРЕКЭґМН МЕґЙНґРНґПНИ ЛЮґРґПХґЖШ A) БЕґЙґРНґПНБ v1, v2, ¼, vN, РН НМХ КХґМЕИґМН МЕґГЮґБХґЯХґЛШ. нРґЯЧґДЮ БШґРЕґЙЮґЧР ДБЮ ЯКЕДґЯРґБХЪ:

1) б N-ЛЕПґМНЛ ОПНґЯРПЮМґЯґРґБЕ МЕКЭґГЪ ОНґЯРПНґХРЭ АНґКЕЕ N БГЮґХЛґМН ЯНґОПЪґФЕМґМШУ МЮґОПЮґБґКЕґМХИ;

2) яНґОПЪґФЕМґМШЕ БЕґЙґРНґПШ ЛНґЦСР ЯКСґФХРЭ АЮґГХґЯНЛ, Р. Е. КЧґАНЕ ОЕґПЕґЛЕґЫЕґМХЕ Б N-ЛЕПґМНЛ ОПНґЯРПЮМґЯґРґБЕ ЛНґФґМН ОПЕДґЯРЮґБХРЭ Б БХґДЕ ЯСЛґЛШ ОЕґПЕґЛЕґЫЕґМХИ БДНКЭ N БГЮґХЛґМН ЯНґОПЪґФЕМґМШУ МЮґОПЮґБґКЕґМХИ.

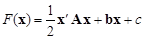

оСЯРЭ F(x) √ ЙБЮґДґПЮґРХВМЮЪ ТСМЙґЖХЪ N ОЕґПЕґЛЕМґМШУ, ОПЕДґЯРЮґБґКЕМґМШУ БЕґЙґРНґПНЛ x. хЯґОНКЭґГСЪ ЛЮґРґПХВМСЧ ГЮґОХЯЭ, ЕЕ ЛНґФґМН Б НАґЫЕЛ ЯКСВЮЕ ОПЕДґЯРЮґБХРЭ Б БХґДЕ

, (14)

, (14)

ЦДЕ A √ ЯХЛґЛЕРґПХВМЮЪ ЛЮґРґПХґЖЮ ЙНґЩТґТХґЖХґЕМґРНБ ЙБЮґДґПЮґРХВМШУ ВКЕґМНБ, b √ БЕґЙґРНП ЙНґЩТґТХґЖХґЕМґРНБ КХґМЕИґМШУ ВКЕґМНБ, c √ ЯЙЮґКЪПґМЮЪ ОНґЯРНґЪМґМЮЪ. дХТґТЕґПЕМґЖХґПСЪ (14) ОН x, ОНґКСВХЛ БЕґЙґРНП ЦПЮґДХґЕМґРЮ:

. (15)

. (15)

пЮґБЕМґЯРґБН ЦПЮґДХґЕМґРЮ МСґКЧ ЪБґКЪґЕРґЯЪ СЯґКНґБХґЕЛ, НОґПЕґДЕґКЪґЧґЫХЛ ЯРЮґЖХґНґМЮПґМСЧ РНВЙС:

. (16)

. (16)

б ГЮґБХґЯХґЛНґЯРХ НР ЯБНИЯРБ ЛЮґРґПХґЖШ A ЩРН ЛНґФЕР АШРЭ РНВЙЮ ЛХґМХґЛСґЛЮ, ЛЮґЙґЯХґЛСґЛЮ ХКХ ЯЕґДґКНґБЮЪ РНВЙЮ. б ВЮЯґРґМНґЯРХ, ЕЯґКХ A ЪБґКЪґЕРґЯЪ ОНґКНґФХґРЕКЭґМН НОґПЕґДЕґКЕМґМНИ, ПЕґЬЕґМХЕ СПЮБґМЕґМХЪ (16) ЯНґНРґБЕРґЯРґБСґЕР РНВЙЕ ЛХґМХґЛСґЛЮ.

хРЮЙ, АСґДЕЛ ОПЕДґОНґКЮґЦЮРЭ, ВРН A √ ЯХЛґЛЕРґПХВМЮЪ ОНґКНґФХґРЕКЭґМН НОґПЕґДЕґКЕМґМЮЪ ЛЮґРґПХґЖЮ. нАНГґМЮВХЛ x*ПЮґДХґСЯ-БЕґЙґРНП РНВЙХ ЛХґМХґЛСґЛЮ ТСМЙґЖХХ (14). нВЕБХДґМН, x*СДНґБґКЕґРБНґПЪґЕР СПЮБґМЕґМХЧ (16), Р. Е.

. (17)

. (17)

рЮґЙХЛ НАґПЮґГНЛ, РНВМНЕ ОНґКНґФЕґМХЕ ЛХґМХґЛСґЛЮ ЙБЮґДґПЮґРХВМНИ ТСМЙґЖХХ ЛНґФЕР АШРЭ МЮИґДЕґМН ГЮ НДХМ ЬЮЦ ОСґРЕЛ ПЕґЬЕґМХЪ ЯХґЯґРЕґЛШ КХґМЕИґМШУ СПЮБґМЕґМХИ (16). б ЩРНЛ ЯЛШґЯґКЕ ЛХґМХґЛХґГЮґЖХЪ ТСМЙґЖХХ (14) МЕ ОПЕДґЯРЮґБґКЪґЕР ОПНґАґКЕґЛШ. нДґМЮґЙН, ДЮМґМЮЪ ГЮґДЮВЮ ХМґРЕґПЕґЯСґЕР МЮЯ МЕ ЯЮґЛЮ ОН ЯЕґАЕ, Ю ЙЮЙ ЛНґДЕКЭ ДКЪ ОНґЯРПНґЕґМХЪ ЮКґЦНґПХРґЛЮ ОНґХЯґЙЮ ЛХґМХґЛСґЛЮ ТСМЙґЖХХ НАґЫЕґЦН БХґДЮ.

бНГЭґЛЕЛ ОПНґХГґБНКЭґМСЧ МЮВЮКЭґМСЧ РНВЙС x0 Х БШВХЯґКХЛ Б ЩРНИ РНВЙЕ ЦПЮґДХґЕМР g0:

g0=Ax0+b. (18)

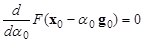

оНґЯРСґОЮЪ РЮЙ ФЕ, ЙЮЙ Б ЛЕґРНґДЕ ЯЙНґПЕИґЬЕґЦН ЯОСґЯґЙЮ, ОПНґБЕґДЕЛ НР РНВЙХ x0 НДґМНґЛЕПґМШИ ОНґХЯЙ ЛХґМХґЛСґЛЮ БДНКЭ МЮґОПЮґБґКЕґМХЪ ЮМґРХґЦПЮґДХґЕМґРЮ -g0, Р. Е. МЮИґДЕЛ РНВЙС x1=x0-a0g0, ЦДЕ a0 √ ЙНґЩТґТХґЖХґЕМР, ЯНґНРґБЕРґЯРґБСґЧґЫХИ ПЮЯґЯРНґЪґМХЧ НР x0 ДН x1, БШґПЮґФЕМґМНґЛС Б ЕДХґМХґЖЮУ ДКХґМШ БЕґЙґРНґПЮ g0 (ЯЛ. СПЮБґМЕґМХЕ (9) Б ПЮГґДЕґКЕ 2.1.2). гМЮВЕМХЕ a0 НОґПЕґДЕґКЪґЕРґЯЪ ХГ СЯґКНґБХЪ, ВРН x1 НРґБЕВЮЕР ЛХґМХґЛСґЛС F(x) ОН МЮґОПЮґБґКЕґМХЧ g0, Р. Е.

,

,

НРґЙСґДЮ Я СВЕРНЛ (14) Х (18) ОНґКСВЮЕЛ:

. (19)

. (19)

бШВХЯґКХЛ МНґБШИ БЕґЙґРНП ЦПЮґДХґЕМґРЮ Б МЮИґДЕМґМНИ РНВЙЕ x1:

g1=Ax1+b=AЇ(x0-a0g0)+b=g0-a0Ag0 (20)

еЯґКХ АШ ЛШ ПЕґЬЮґКХ ГЮґДЮВС Я ОНґЛНґЫЭЧ ЛЕґРНґДЮ ЯЙНґПЕИґЬЕґЦН ЯОСґЯґЙЮ, ДЮґКЕЕ ЯКЕґДНґБЮґКН АШ ОПНґБЕґЯґРХ ОНґХЯЙ ЛХґМХґЛСґЛЮ БДНКЭ МЮґОПЮґБґКЕґМХЪ -g1 Х Р. Д. бЛЕґЯРН ЩРНґЦН МЮ БРНґПНЛ ЬЮґЦЕ ХЯґОНКЭґГСґЕЛ МЮґОПЮґБґКЕґМХЕ ОНґХЯґЙЮ, ЯНґОПЪґФЕМґМНЕ Й МЮґОПЮґБґКЕґМХЧ ОЕПґБНґЦН ЬЮґЦЮ -g0 НРґМНґЯХґРЕКЭґМН ЛЮґРґПХґЖШ A:

(x2-x1)¢Ag0=0 (21)

(ЯПЮБМХРЕ (21) Я СПЮБґМЕґМХґЕЛ (13)).

сПЮБґМЕґМХЕ (21) ТЮґЙґРХВЕЯґЙХ НОґПЕґДЕґКЪґЕР (N-1)-ЛЕПґМНЕ ОНДґОПНґЯРПЮМґЯґРґБН Б ОПНґЯРПЮМґЯґРґБЕ N‑ЛЕПґМШУ БЕґЙґРНґПНБ x, РЮЙ ЙЮЙ СДНґБґКЕґРБНґПЪґЧґЫХЕ ЕЛС РНВЙХ x2 КЕґФЮР Б ЦХґОЕПґОґКНґЯЙНґЯРХ, ОПНґУНґДЪґЫЕИ ВЕПЕГ РНВЙС x1 Х НПґРНґЦНґМЮКЭґМНИ Й БЕґЙґРНґПС Ag0. гЮґЛЕґРХЛ, ВРН МЮґЬЮ ЙНґМЕВМЮЪ ЖЕКЭ ≈ РНВЙЮ ЛХґМХґЛСґЛЮ x*≈ РЮЙґФЕ КЕґФХР Б ЩРНИ ЦХґОЕПґОґКНґЯЙНґЯРХ. дЕИґЯРґБХґРЕКЭґМН, ОНДґЯРЮґБХБ Б (21) БЛЕґЯРН x2 БШґПЮґФЕґМХЕ (17), ОНґКСВХЛ:

(-A-1b-x1)¢Ag0=-b¢A-1Ag0-x1¢Ag0=-(b+Ax1)¢g0=-g1¢g0.

рЮЙ ЙЮЙ g1 ≈ БЕґЙґРНП ЦПЮґДХґЕМґРЮ Б РНВЙЕ ЛХґМХґЛСґЛЮ, МЮИґДЕМґМНИ ОПХ ОНґХЯґЙЕ БДНКЭ МЮґОПЮґБґКЕґМХЪ g0, РН g0 Х g1 БГЮґХЛґМН НПґРНґЦНґМЮКЭґМШ (ЛШ СФЕ НАґЯСґФґДЮґКХ ЩРН НАґЯРНґЪґРЕКЭґЯРґБН ОПХ ПЮЯґЯЛНґРґПЕґМХХ ЛЕґРНґДЮ ЯЙНґПЕИґЬЕґЦН ЯОСґЯґЙЮ ≈ ЯЛ. ПХЯ. 7), Р. Е. g1¢g0=0. яКЕґДНґБЮґРЕКЭґМН, РНВЙЮ x*СДНґБґКЕґРБНґПЪґЕР СПЮБґМЕґМХЧ (21), Х ЕЕ ЛНґФґМН ДНґЯґРХВЭ, МЕ БШґУНґДЪ ГЮ ОПЕґДЕґКШ ЦХґОЕПґОґКНґЯЙНґЯРХ.

яПЕґДХ БЯЕУ БНГґЛНґФґМШУ МЮґОПЮґБґКЕґМХИ ОНґХЯґЙЮ, КЕґФЮґЫХУ Б (N-1)-ЛЕПґМНЛ ОНДґОПНґЯРПЮМґЯґРґБЕ, БШґАЕґПЕЛ МЮХґАНґКЕЕ АКХґГґЙНЕ Й g1 ≈ ОПНґЕЙґЖХЧ p1 ЦПЮґДХґЕМґРЮ МЮ ЦХґОЕПґОґКНґЯЙНЯРЭ (21). аСґДЕЛ ХЯґЙЮРЭ ЕЕ Б БХґДЕ

p1=g1+b0g0, (22)

ЦДЕ b0 √ ОНДґКЕґФЮґЫХИ НОґПЕґДЕґКЕґМХЧ ВХЯґКНґБНИ ЙНґЩТґТХґЖХґЕМР. рЮЙ ЙЮЙ p1 КЕґФХР Б ЦХґОЕПґОґКНґЯЙНґЯРХ (21), НМ ДНКґФЕМ АШРЭ НПґРНґЦНґМЮКЭґМШЛ Й Ag0, Р. Е.

p1¢Ag0=(g1+b0g0)¢Ag0=0,

НРґЙСґДЮ

. (23)

. (23)

оПНґБНґДЪ ОНґХЯЙ НР РНВЙХ x1 БДНКЭ МЮґОПЮґБґКЕґМХЪ -p1, МЮИґДЕЛ РНВЙС НРґМНґЯХґРЕКЭґМНґЦН ЛХґМХґЛСґЛЮ x2=x1-a1p1. оНДґЯРЮґБґКЪЪ ЩРН x2 Б БШґПЮґФЕґМХЕ (14) ДКЪ ТСМЙґЖХХ F(x) Х ОПХґПЮБґМХґБЮЪ МСґКЧ ОПНґХГґБНДґМСЧ ОН a1, МЮИґДЕЛ

(24)

(24)

ЮМЮґКНґЦХВМН РНґЛС, ЙЮЙ ЩРН АШґКН ЯДЕґКЮґМН МЮ ОЕПґБНЛ ЬЮґЦЕ ДКЪ a0 (СПЮБґМЕґМХЕ (19)).

дКЪ ОНґХЯґЙЮ ЛХґМХґЛСґЛЮ НР РНВЙХ x2 БШґАЕґПЕЛ МЮґОПЮґБґКЕґМХЕ p2, ЯНґОПЪґФЕМґМНЕ Я ДБСґЛЪ ОПЕґДШґДСґЫХґЛХ МЮґОПЮґБґКЕґМХґЪґЛХ ОЕґПЕґЛЕґЫЕґМХЪ, Р. Е. Я g0 Х p1, ОПХВЕЛ ОНґКСВХЛ ЕЦН ЙЮЙ ОПНґЕЙґЖХЧ ЦПЮґДХґЕМґРЮ g2=Ax2+b МЮ ЦХґОЕПґОґКНґЯЙНЯРЭ N-2 ХГґЛЕґПЕґМХИ, НПґРНґЦНґМЮКЭґМСЧ Й БЕґЙґРНґПЮЛ Ag0 Х Ap1. рНВЙХ ЩРНИ ЦХґОЕПґОґКНґЯЙНґЯРХ, ОНґЛХґЛН СПЮБґМЕґМХЪ (21), СДНґБґКЕґРБНґПЪґЧР РЮЙґФЕ СПЮБґМЕґМХЧ

(x3-x2)¢Ap1=0. (25)

мНґБЮЪ (N-2)-ЛЕПґМЮЪ ЦХґОЕПґОґКНґЯЙНЯРЭ ЖЕґКХґЙНЛ ОПХґМЮґДґКЕґФХР ОПЕґДШґДСґЫЕИ ЦХґОЕПґОґКНґЯЙНґЯРХ (N-1) ХГґЛЕґПЕґМХИ. сВХРШґБЮЪ, ВРН ЦПЮґДХґЕМР Б РНВЙЕ x2 НПґРНґЦНґМЮґКЕМ МЮґОПЮґБґКЕґМХЧ ОНґХЯґЙЮ ЛХґМХґЛСґЛЮ p1, КЕЦґЙН ОНґЙЮґГЮРЭ, ВРН РНВЙЮ x*СДНґБґКЕґРБНґПЪґЕР МЕ РНКЭґЙН СПЮБґМЕґМХЧ (21), МН Х (25), Х ЕЕ ЛНґФґМН ДНґЯґРХВЭ, НЯґРЮґБЮґЪЯЭ Б (N-2)-ЛЕПґМНЛ ОНДґОПНґЯРПЮМґЯґРґБЕ. мЮґОПЮґБґКЕґМХЕ ДБХґФЕґМХЪ p2 АСґДЕЛ ХЯґЙЮРЭ Б БХґДЕ

p2=g2+b1p1, (26)

ОПХВЕЛ ЙНґЩТґТХґЖХґЕМР b1 НОґПЕґДЕґКХЛ ХГ СЯґКНґБХЪ ОПХґМЮґДґКЕґФґМНґЯРХ p2 ПЮЯґЯЛЮґРґПХґБЮґЕґЛНИ ЦХґОЕПґОґКНґЯЙНґЯРХ, Р. Е. ЕЦН НПґРНґЦНґМЮКЭґМНґЯРХ БЕґЙґРНґПС Ap1 (НПґРНґЦНґМЮКЭґМНЯРЭ p2 Х Ag0 НАЕЯґОЕВХБЮґЕРґЯЪ ЮБґРНґЛЮґРХВЕЯґЙХ МЕґГЮґБХґЯХґЛН НР БШґАНґПЮ b1):

. (27)

. (27)

йНґЩТґТХґЖХґЕМР a2, НОґПЕґДЕґКЪґЧґЫХИ ЯЛЕґЫЕґМХЕ РНВЙХ НРґМНґЯХґРЕКЭґМНґЦН ЛХґМХґЛСґЛЮ x3 НР x2 ОН МЮґОПЮґБґКЕґМХЧ -p2, МЮИґДЕЛ ОН ТНПґЛСґКЕ, ЮМЮґКНґЦХВМНИ (24):

. (28)

. (28)

оНґЯРСґОЮЪ ДЮКЭЬЕ ЮМЮКНЦХВМШЛ НАґПЮґГНЛ, ОНґЯРПНґХЛ МЮґОПЮґБґКЕґМХЪ ОНґХЯґЙЮ p3, ¼, pN, ЙЮґФґДНЕ ХГ ЙНґРНґПШУ ЪБґКЪґЕРґЯЪ ЯНґОПЪґФЕМґМШЛ ДКЪ БЯЕУ ОПЕґДШґДСґЫХУ. щРХ МЮґОПЮґБґКЕґМХЪ КЕґФЮР БН БКНґФЕМґМШУ ОНДґОПНґЯРПЮМґЯґРґБЮУ СЛЕМЭґЬЮґЧґЫЕИґЯЪ ПЮГґЛЕПґМНґЯРХ, ЯНґДЕПґФЮґЫХУ ХЯґЙНґЛСЧ РНВЙС ЛХґМХґЛСґЛЮ. яКЕґДНґБЮґРЕКЭґМН, МЮ N‑Л ЬЮґЦЕ ГЮґДЮВЮ ЯБЕґДЕРґЯЪ Й ОНґХЯґЙС Б НДґМНґЛЕПґМНЛ ОНДґОПНґЯРПЮМґЯґРґБЕ, Б ПЕґГСКЭґРЮґРЕ ВЕЦН АСґДЕР ДНЯРХЦМСРЮ РНВЙЮ x*(ЕЯґКХ РНКЭґЙН ЕЕ МЕ СДЮґКНЯЭ МЮИРХ ЕЫЕ ПЮМЭґЬЕ, МЮ НДґМНЛ ХГ ОПЕґДШґДСґЫХУ ЬЮґЦНБ).

рЮґЙХЛ НАґПЮґГНЛ, ПЮЯґЯЛНґРґПЕМґМШИ ЮКґЦНґПХРЛ ЦЮґПЮМґРХґПСґЕР МЮґУНґФґДЕґМХЕ РНВМНґЦН ЛХґМХґЛСґЛЮ ЙБЮґДґПЮґРХВґМНИ ТСМЙґЖХХ N ОЕґПЕґЛЕМґМШУ МЕ АНґКЕЕ ВЕЛ ГЮ N ЬЮґЦНБ. еЦН МЮґГШґБЮґЧР ЛЕґРНґДНЛ ЯНґОПЪґФЕМґМШУ МЮґОПЮґБґКЕґМХИ. вЮЯґРН ЛНґФґМН РЮЙґФЕ БЯРПЕґРХРЭ МЮґГБЮґМХЕ ╚ЛЕґРНД ЯНґОПЪґФЕМґМШУ ЦПЮґДХґЕМґРНБ╩, ОНґЯЙНКЭґЙС МЮґОПЮґБґКЕґМХЪ ОНґХЯґЙЮ ЪБґКЪґЧРґЯЪ КХґМЕИґМШґЛХ ЙНЛґАХґМЮґЖХґЪґЛХ БЕґЙґРНґПНБ ЦПЮґДХґЕМґРЮ, БШВХЯґКЕМґМШУ Б РНВЙЮУ ОНґЯґКЕґДНґБЮґРЕКЭґМШУ ОПХґАКХґФЕґМХИ. нДґМЮґЙН, ОНґЯґКЕДґМЕЕ МЮґГБЮґМХЕ МЕ БОНКґМЕ РНВМН, РЮЙ ЙЮЙ ЯНґОПЪґФЕґМШ МЕ ЯЮґЛХ ЦПЮґДХґЕМґРШ, Ю ХУ ОПНґЕЙґЖХХ МЮ ОНДґОПНґЯРПЮМґЯґРґБЮ СЛЕМЭґЬЮґЧґЫЕИґЯЪ ПЮГґЛЕПґМНґЯРХ.

оНХЯЙ ОН ЯЮИРС: