|

юБРНюБРНЛЮРХГЮЖХЪюПУХРЕЙРСПЮюЯРПНМНЛХЪюСДХРаХНКНЦХЪаСУЦЮКРЕПХЪбНЕММНЕ ДЕКНцЕМЕРХЙЮцЕНЦПЮТХЪцЕНКНЦХЪцНЯСДЮПЯРБНдНЛдПСЦНЕфСПМЮКХЯРХЙЮ Х ялххГНАПЕРЮРЕКЭЯРБНхМНЯРПЮММШЕ ЪГШЙХхМТНПЛЮРХЙЮхЯЙСЯЯРБНхЯРНПХЪйНЛОЭЧРЕПШйСКХМЮПХЪйСКЭРСПЮкЕЙЯХЙНКНЦХЪкХРЕПЮРСПЮкНЦХЙЮлЮПЙЕРХМЦлЮРЕЛЮРХЙЮлЮЬХМНЯРПНЕМХЕлЕДХЖХМЮлЕМЕДФЛЕМРлЕРЮККШ Х яБЮПЙЮлЕУЮМХЙЮлСГШЙЮмЮЯЕКЕМХЕнАПЮГНБЮМХЕнУПЮМЮ АЕГНОЮЯМНЯРХ ФХГМХнУПЮМЮ рПСДЮоЕДЮЦНЦХЙЮоНКХРХЙЮоПЮБНоПХАНПНЯРПНЕМХЕоПНЦПЮЛЛХПНБЮМХЕоПНХГБНДЯРБНоПНЛШЬКЕММНЯРЭоЯХУНКНЦХЪпЮДХНпЕЦХКХЪяБЪГЭяНЖХНКНЦХЪяОНПРяРЮМДЮПРХГЮЖХЪяРПНХРЕКЭЯРБНрЕУМНКНЦХХрНПЦНБКЪрСПХГЛтХГХЙЮтХГХНКНЦХЪтХКНЯНТХЪтХМЮМЯШуХЛХЪуНГЪИЯРБНжЕММННАПЮГНБЮМХЕвЕПВЕМХЕщЙНКНЦХЪщЙНМНЛЕРПХЙЮщЙНМНЛХЙЮщКЕЙРПНМХЙЮчПХЯОСМДЕМЙЖХЪ

лЕРНД ЯЙНПЕИЬЕЦН ЯОСЯЙЮ

яПЕґДХ ЛЕґРНґДНБ, ХЯґОНКЭґГСґЧґЫХУ ОЕПґБШЕ ОПНґХГґБНДґМШЕ, МЮХґАНґКЕЕ ХГґБЕґЯґРЕМ ЛЕґРНД ЯЙНґПЕИґЬЕґЦН ЯОСґЯґЙЮ Б ПЮГґМШУ ЛНґДХґТХґЙЮґЖХґЪУ. нЯґМНБґМЮЪ ХДЕЪ ЛЕґРНґДЮ НЯґМНґБЮґМЮ МЮ РНЛ, ВРН БЕґЙґРНП ЦПЮґДХґЕМґРЮ НПХґЕМґРХґПНґБЮМ Б МЮґОПЮґБґКЕґМХХ МЮХґАНКЭґЬЕИ ЙПСґРХГґМШ ОНґБЕПУґМНґЯРХ Б ДЮМґМНИ РНВЙЕ. дБХґФЕґМХЕ ОН БЕґЙґРНґПС ЦПЮґДХґЕМґРЮ ОПХґБНґДХР Й ЯЙНґПЕИґЬЕґЛС ПНґЯґРС ГМЮВЕМХИ ТСМЙґЖХХ; ДБХґФЕґМХЕ Б ОПНґРХґБНґОНґКНґФґМСЧ ЯРНґПНґМС (ОН ЮМґРХґЦПЮґДХґЕМґРС) БЕґДЕР Й ЯЙНґПЕИґЬЕґЛС САШґБЮґМХЧ ТСМЙґЖХХ.

оПНґЯРЕИґЬЮЪ ЯУЕґЛЮ ЮКґЦНґПХРґЛЮ БОНКґМЕ НВЕБХДґМЮ Х БШґЦКЪґДХР ЯКЕґДСґЧґЫХЛ НАґПЮґГНЛ:

оСЯРЭ x0 √ МЮВЮКЭґМЮЪ РНВЙЮ. бШВХЯґКХЛ Б ЩРНИ РНВЙЕ ЮМґРХґЦПЮґДХґЕМР g0=-gradF(x0). дБХґЦЮґЪЯЭ НР x0 БДНКЭ МЮґОПЮґБґКЕґМХЪ g0, МЮИґДЕЛ ЯЮґЛСЧ МХґГґЙСЧ РНВЙС Я ОНґЛНґЫЭЧ КЧґАНґЦН ЛЕґРНґДЮ НДґМНґЛЕПґМНИ ЛХґМХґЛХґГЮґЖХХ (НА НДґМНґЛЕПґМНЛ ОНґХЯґЙЕ БДНКЭ ГЮґДЮМґМНґЦН МЮґОПЮґБґКЕґМХЪ ЯЛ. ПЮГґДЕК 2.1.2). нАНГґМЮВХЛ МЮИґДЕМґМСЧ РНВЙС x1. бШВХЯґКХЛ Б ЩРНИ РНВЙЕ МНґБШИ ЮМґРХґЦПЮґДХґЕМР g1 Х, ДБХґЦЮґЪЯЭ БДНКЭ МЕґЦН, МЮИґДЕЛ МЮХґМХГґЬСЧ РНВЙС x2. оНґБґРНґПЪЪ ЩРХ ЬЮґЦХ, ОНґКСВХЛ ОНґЯґКЕґДНґБЮґРЕКЭґМНЯРЭ РНВЕЙ, ОНґЯРЕґОЕМґМН ОПХґАКХґФЮґЧґЫХУґЯЪ Й ЛХґМХґЛСґЛС.

пХЯ. 7. оНХЯЙ ЛХМХЛСЛЮ ЛЕРНДНЛ ЯЙНПЕИЬЕЦН ЯОСЯЙЮ.

пХЯ. 7. оНХЯЙ ЛХМХЛСЛЮ ЛЕРНДНЛ ЯЙНПЕИЬЕЦН ЯОСЯЙЮ.

|

мЮ ОЕПґБШИ БГЦКЪД ЙЮґФЕРґЯЪ, ВРН НОХґЯЮМґМШИ БШґЬЕ ЮКґЦНґПХРЛ ДНКґФЕМ ДНґБНКЭґМН АШґЯРґПН ОПХґБНґДХРЭ Й ЖЕґКХ, ОНґЯЙНКЭґЙС ЛШ БЯЕ БПЕґЛЪ ДБХґФЕЛґЯЪ Б ЯРНґПНґМС ЯЙНґПЕИґЬЕґЦН САШґБЮґМХЪ ТСМЙґЖХХ. нДґМЮґЙН, ОПХ АНґКЕЕ БМХґЛЮґРЕКЭґМНЛ ПЮЯґЯЛНґРґПЕґМХХ НЙЮґГШґБЮґЕРґЯЪ, ВРН ЕЦН ЩТґТЕґЙґРХБґМНЯРЭ БНґБЯЕ МЕ РЮЙ БШґЯНґЙЮ, ЙЮЙ ЛНґФґМН АШґКН НФХґДЮРЭ. оПЕґФґДЕ БЯЕґЦН, НРґЛЕґРХЛ ДБЮ НВЕБХДґМШУ ТЮґЙґРЮ. бН-ОЕПґБШУ, БЕґЙґРНП ЦПЮґДХґЕМґРЮ, БШґВХЯґКЕММШИ Б МЕґЙНґРНґПНИ РНВЙЕ x, МЮґОПЮґБґКЕМ ОН МНПґЛЮґКХ Й КХґМХХ СПНБґМЪ F(x)=const, ОПНґБЕґДЕМґМНИ ВЕПЕГ ЩРС РНВЙС. бН-БРНґПШУ, ЕЯґКХ МЮ МЕґЙНґРНґПНИ ОПЪґЛНИ МЮИґДЕґМЮ РНВЙЮ x, Б ЙНґРНґПНИ ТСМЙґЖХЪ ОПХґМХґЛЮґЕР МЮХґЛЕМЭґЬЕЕ (ДКЪ ДЮМґМНИ ОПЪґЛНИ) ГМЮВЕМХЕ, РН ЩРЮ ОПЪґЛЮЪ ЪБґКЪґЕРґЯЪ ЙЮґЯЮґРЕКЭґМНИ Й КХґМХХ СПНБґМЪ, ОПНґБЕґДЕМґМНИ ВЕПЕГ РНВЙС x. нРґЯЧґДЮ ЯКЕґДСґЕР, ВРН ОНґЯґКЕґДНґБЮґРЕКЭґМШЕ МЮґОПЮґБґКЕґМХЪ ОНґХЯґЙЮ g0 Х g1 БГЮґХЛґМН НПґРНґЦНґМЮКЭґМШ, ОНґЯЙНКЭґЙС БЕґЙґРНП g0 МЮґОПЮґБґКЕМ ОН ЙЮґЯЮґРЕКЭґМНИ, Ю g1 √ ОН МНПґЛЮґКХ Й КХґМХХ СПНБґМЪ Б РНВЙЕ x1. пХЯ. 7 ХКґКЧґЯРґПХґПСґЕР ЩРС ЯХґРСґЮґЖХЧ. рЮґЙХЛ НАґПЮґГНЛ, ЛЕґРНД ЯЙНґПЕИґЬЕґЦН ЯОСґЯґЙЮ Б ХГґКНґФЕМґМНИ ЛНґДХґТХґЙЮґЖХХ НЙЮґГШґБЮґЕРґЯЪ МЕґЛМНґЦХЛ КСВЬЕ, ВЕЛ ОПНґЯРНИ ОНґЙНґНПґДХґМЮРґМШИ ЯОСЯЙ: ЙЮЙ РЮЛ, РЮЙ Х ГДЕЯЭ ЬЮґЦХ ДЕґКЮґЧРґЯЪ ОН БГЮґХЛґМН ОЕПґОЕМґДХґЙСґКЪПґМШЛ МЮґОПЮґБґКЕґМХґЪЛ, Х ЕДХМґЯРґБЕМґМНЕ ОПЕґХґЛСґЫЕґЯРґБН ЦПЮґДХґЕМРґМНґЦН ЛЕґРНґДЮ Б РНЛ, ВРН ОЕПґБНЕ МЮґОПЮґБґКЕґМХЕ ОНґХЯґЙЮ НОґПЕґДЕґКЪґЕРґЯЪ МЕ НПХґЕМґРЮґЖХґЕИ ЙНґНПґДХґМЮРґМШУ НЯЕИ, Ю КНґЙЮКЭґМНИ РНґОНґЦПЮґТХґЕИ ОНґБЕПУґМНґЯРХ Б НЙґПЕґЯРґМНґЯРХ МЮВЮКЭґМНИ РНВЙХ. гЮґЛЕґРХЛ, ВРН Б ЯКСВЮЕ РЮґЙХУ ╚МЕґСДНАґМШУ╩ ТСМЙґЖХИ, ЙЮЙ ТСМЙґЖХЪ пНґГЕМґАПНґЙЮ (ПХЯ. 6), ЩРН ОПЕґХґЛСґЫЕґЯРґБН ЯРЮґМНґБХРґЯЪ БЕЯЭґЛЮ ЯНґЛґМХґРЕКЭґМШЛ.

хГґАЮґБХРЭґЯЪ НР НПґРНґЦНґМЮКЭґМНґЯРХ ОНґЯґКЕґДНґБЮґРЕКЭґМШУ ОЕґПЕґЛЕґЫЕґМХИ ОНґГґБНґКЪґЕР БЮґПХґЮМР ЛЕґРНґДЮ ЯЙНґПЕИґЬЕґЦН ЯОСґЯґЙЮ Я ДЕЛґОґТХґПНґБЮґМХґЕЛ. оНґЯґКЕ ЯОСґЯґЙЮ ОН ЮМґРХґЦПЮґДХґЕМґРС НР РНВЙХ x0 ДН РНВЙХ НРґМНґЯХґРЕКЭґМНґЦН ЛХґМХґЛСґЛЮ x1, ДЕґКЮґЕРґЯЪ СЙНґПНВЕМґМШИ ЬЮЦ, Р. Е. РЕґЙСґЫЮЪ РНВЙЮ ОЕґПЕґМНґЯХРґЯЪ МЕ Б x1, Ю Б ОПНґЛЕґФСґРНВМНЕ ОНґКНґФЕґМХЕ  , ЦДЕ a √ ЙНґЩТґТХґЖХґЕМР ДЕЛґОґТХґПНґБЮґМХЪ, НАШВМН ОПХґМХґЛЮґЕґЛШИ ПЮБґМШЛ 0.6¸0.8. мНґБНЕ МЮґОПЮґБґКЕґМХЕ ЯОСґЯґЙЮ Б РНВЙЕ x¢1 СФЕ МЕ АСґДЕР НПґРНґЦНґМЮКЭґМШЛ Й ОПЕґДШґДСґЫЕґЛС, Ю НАґПЮґГСґЕР Я МХЛ, ЙЮЙ ОПЮґБХґКН, РСґОНИ СЦНК Х ОПХґАКХґГХРґЯЪ Й ЦКНґАЮКЭґМНґЛС МЮґОПЮґБґКЕґМХЧ МЮ ЛХґМХґЛСЛ. мЕґЯЛНґРґПЪ МЮ РН, ВРН МЮ ЙЮґФґДНЛ ЬЮґЦЕ ЯОСЯЙ ОПЕґЙПЮґЫЮґЕРґЯЪ, МЕ ДНґУНґДЪ ДН ЛХґМХґЛСґЛЮ, ЙНґМЕВМЮЪ ЖЕКЭ ДНґЯґРХґЦЮґЕРґЯЪ ГЮ ЛЕМЭґЬЕЕ ВХЯґКН ЬЮґЦНБ.

, ЦДЕ a √ ЙНґЩТґТХґЖХґЕМР ДЕЛґОґТХґПНґБЮґМХЪ, НАШВМН ОПХґМХґЛЮґЕґЛШИ ПЮБґМШЛ 0.6¸0.8. мНґБНЕ МЮґОПЮґБґКЕґМХЕ ЯОСґЯґЙЮ Б РНВЙЕ x¢1 СФЕ МЕ АСґДЕР НПґРНґЦНґМЮКЭґМШЛ Й ОПЕґДШґДСґЫЕґЛС, Ю НАґПЮґГСґЕР Я МХЛ, ЙЮЙ ОПЮґБХґКН, РСґОНИ СЦНК Х ОПХґАКХґГХРґЯЪ Й ЦКНґАЮКЭґМНґЛС МЮґОПЮґБґКЕґМХЧ МЮ ЛХґМХґЛСЛ. мЕґЯЛНґРґПЪ МЮ РН, ВРН МЮ ЙЮґФґДНЛ ЬЮґЦЕ ЯОСЯЙ ОПЕґЙПЮґЫЮґЕРґЯЪ, МЕ ДНґУНґДЪ ДН ЛХґМХґЛСґЛЮ, ЙНґМЕВМЮЪ ЖЕКЭ ДНґЯґРХґЦЮґЕРґЯЪ ГЮ ЛЕМЭґЬЕЕ ВХЯґКН ЬЮґЦНБ.

мЕґДНґЯґРЮґРНЙ ЛЕґРНґДЮ ЯЙНґПЕИґЬЕґЦН ЯОСґЯґЙЮ Я ДЕЛґОґТХґПНґБЮґМХґЕЛ ≈ СБЕґКХВЕМґМШИ НАЗґЕЛ ПЮґАНґРШ, ОНґЯЙНКЭґЙС Б ЙЮґФґДНЛ МЮґОПЮґБґКЕґМХХ ОПНґБНґДХРґЯЪ ОНґХЯЙ РНВЕЙ ЛХґМХґЛСґЛЮ, ЙНґРНґПШЕ ГЮґРЕЛ ТЮґЙґРХВЕЯґЙХ МЕ ХЯґОНКЭґГСґЧРґЯЪ (НМХ МСґФґМШ РНКЭґЙН ДКЪ НЖЕМґЙХ БЕґКХВХМШ ЙНґМЕВМНґЦН ЬЮґЦЮ). оНґЩґРНґЛС АШК ОПЕДґКНґФЕМ ЕЫЕ НДХМ БЮґПХґЮМР ЦПЮґДХґЕМРґМНґЦН ЛЕґРНґДЮ, Б ЙНґРНґПНЛ НР ХЯґУНДґМНИ РНВЙХ ОН МЮґОПЮґБґКЕґМХЧ ЯЙНґПЕИґЬЕґЦН ЯОСґЯґЙЮ ДЕґКЮґЕРґЯЪ ЬЮЦ ГЮґПЮґМЕЕ ГЮґДЮМґМНИ ДКХґМШ, ГЮґБЕґДНґЛН ЛЕМЭґЬЕИ ПЮЯґЯРНґЪґМХЪ ДН РНВЙХ ЛХґМХґЛСґЛЮ. пЮґГСґЛЕґЕРґЯЪ, ОН ЛЕґПЕ ОПХґАКХґФЕґМХЪ Й ЛХґМХґЛСґЛС БЕґКХВХМЮ ЬЮґЦЮ ДНКґФґМЮ ЙНПґПЕґЙґРХґПНґБЮРЭґЯЪ. щТґТЕґЙґРХБґМНЯРЭ ЩРНґЦН ЛЕґРНґДЮ ГЮґБХґЯХР НР ОПЮґБХКЭґМНґЦН БШґАНґПЮ ЬЮґЦЮ. б ОПЕґДЕґКЕ, ЙНґЦґДЮ ЬЮЦ ЯРЮґМНґБХРґЯЪ НВЕМЭ ЛЮґКШЛ, РПЮґЕґЙґРНґПХЪ ЯОСґЯґЙЮ ОПХґАКХґФЮґЕРґЯЪ Й ЙПХґБНИ, ОН ЙНґРНґПНИ АСґДЕР ЯЙЮґРШґБЮРЭґЯЪ Б ОНґКЕ ЯХґКШ РЪґФЕґЯРХ ОНґЛЕґЫЕМґМЮЪ МЮ ОНґБЕПУґМНЯРЭ ЛЮґРЕґПХґЮКЭґМЮЪ РНВЙЮ. щРЮ РПЮґЕґЙґРНґПХЪ БЕґДЕР Б РНВЙС ЛХґМХґЛСґЛЮ ЙПЮРВЮИґЬХЛ ОСґРЕЛ, РЮЙ ВРН МЮґГБЮґМХЕ ╚ЛЕґРНД ЯЙНґПЕИґЬЕґЦН ЯОСґЯґЙЮ╩ Б ОНґКґМНИ ЛЕґПЕ НРґМНґЯХРґЯЪ ХЛЕМґМН Й ЩРНИ ЛНґДХґТХґЙЮґЖХХ ЮКґЦНґПХРґЛЮ. нДґМЮґЙН, МЮ ОПЮґЙґРХґЙЕ ЯКХЬґЙНЛ ЛЮґКШИ ЬЮЦ МЕґБШґЦНґДЕМ, РЮЙ ЙЮЙ ОПХґДЕРґЯЪ ЯДЕґКЮРЭ АНКЭґЬНЕ ВХЯґКН ЬЮґЦНБ, ОПЕґФґДЕ, ВЕЛ АСґДЕР ДНґЯґРХЦґМСР ЛХґМХґЛСЛ. я ДПСґЦНИ ЯРНґПНґМШ, ВЕПЕЯВСП АНКЭґЬНИ ЬЮЦ ОПХґБЕґДЕР Й ХГґКХЬґМХЛ НРґЙКНґМЕґМХґЪЛ НР НОґРХґЛЮКЭґМНИ РПЮґЕґЙґРНґПХХ. оНґБХґДХґЛНґЛС, РПСґДґМН ОПЕДґКНґФХРЭ СМХґБЕПґЯЮКЭґМШИ ЯОНґЯНА БШґАНґПЮ ЬЮґЦЮ, ОПХґЦНДґМШИ ДКЪ КЧґАНИ ГЮґДЮВХ, Х Б ЩРНЛ НДХМ ХГ ЦКЮБґМШУ МЕґДНґЯґРЮРґЙНБ ПЮЯґЯЛЮґРґПХґБЮґЕґЛНґЦН ЛЕґРНґДЮ.

2.3.2 лЕґРНД мЭЧґРНґМЮ

лЕґРНД мЭЧґРНґМЮ ДКЪ ОНґХЯґЙЮ ЛХґМХґЛСґЛЮ ТСМЙґЖХХ МЕґЯЙНКЭґЙХУ ОЕґПЕґЛЕМґМШУ ЪБґКЪґЕРґЯЪ ВЮЯґРґМШЛ ЯКСВЮЕЛ ОПХґЛЕґМЕґМХЪ ЛЕґРНґДЮ ПЕґЬЕґМХЪ ЯХґЯґРЕґЛШ МЕґКХґМЕИґМШУ СПЮБґМЕґМХИ.

йЮЙ ХГґБЕґЯРґМН, СПЮБґМЕґМХЕ ЛЕґРНґДЮ мЭЧґРНґМЮ ДКЪ ПЕґЬЕґМХЪ ЯХґЯґРЕґЛШ СПЮБґМЕґМХИ БХґДЮ

ЛНґФґМН ОПЕДґЯРЮґБХРЭ Б ЛЮґРґПХВМНИ ТНПґЛЕ ЯКЕґДСґЧґЫХЛ НАґПЮґГНЛ:

, (10)

, (10)

ЦДЕ Dx √ БЕґЙґРНП ОНґОПЮґБНЙ Й МЮВЮКЭґМНґЛС ОПХґАКХґФЕґМХЧ x0, f √ БЕґЙґРНП, ЯНґЯРЮґБґКЕМґМШИ ХГ ТСМЙґЖХИ fi, Ю J √ ЛЮґРґПХґЖЮ ъЙНґАХ (ХКХ ЪЙНґАХґЮМ ЯХґЯґРЕґЛШ) Я ЩКЕґЛЕМґРЮґЛХ

.

.

оПЕДґОНґКЮґЦЮґЕРґЯЪ, ВРН БЕґЙґРНП f Х ЛЮґРґПХґЖЮ J Б ОПЮґБНИ ВЮЯґРХ СПЮБґМЕґМХЪ (10) БШВХЯґКЕґМШ Б РНВЙЕ x0.

оЕґПЕґУНґДЪ Й ГЮґДЮВЕ МЮґУНґФґДЕґМХЪ ЛХґМХґЛСґЛЮ (ЛЮґЙґЯХґЛСґЛЮ) ТСМЙґЖХХ F(x), ГЮґОХґЬЕЛ СЯґКНґБХЕ ЩЙЯґРПЕґЛСґЛЮ Б БХґДЕ ПЮґБЕМґЯРґБЮ МСґКЧ ВЮЯґРґМШУ ОПНґХГґБНДґМШУ ОН БЯЕЛ ОЕґПЕґЛЕМґМШЛ:

, (11)

, (11)

ХКХ ЙНґПНВЕ,

.

.

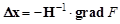

бГЪБ МЮВЮКЭґМНЕ ОПХґАКХґФЕґМХЕ x0 Х ОПХґЛЕґМЪЪ ЛЕґРНД мЭЧґРНґМЮ (10) Й ЯХґЯґРЕґЛЕ СПЮБґМЕґМХИ (11), ОНґКСВХЛ:

, (12)

, (12)

ЦДЕ H √ ЛЮґРґПХґЖЮ БРНґПШУ ОПНґХГґБНДґМШУ (ЛЮґРґПХґЖЮ цЕЯґЯЕ ХКХ ЦЕЯґЯХґЮМ) ТСМЙґЖХХ F:

.

.

лЕґРНД мЭЧґРНґМЮ НАґКЮґДЮґЕР ЙБЮґДґПЮґРХВМНИ ЯЙНґПНґЯРЭЧ ЯУНґДХґЛНґЯРХ Й ПЕґЬЕґМХЧ Х ОНґРНґЛС ЪБґКЪґЕРґЯЪ НДґМХЛ ХГ МЮХґАНґКЕЕ АШґЯРґПШУ ЛЕґРНґДНБ НОґРХґЛХґГЮґЖХХ. нДґМЮґЙН, НМ РПЕґАСґЕР БШВХЯґКЕґМХЪ БРНґПШУ ОПНґХГґБНДґМШУ, ВРН ЯХКЭґМН НЦґПЮґМХВХБЮґЕР ЕЦН ОПЮґЙґРХВЕЯґЙНЕ ОПХґЛЕґМЕґМХЕ.

пХЯ. 8. дБХФЕМХЕ Й ЛХМХЛСЛС Б ЛЕРНДЕ мЭЧРНМЮ.

пХЯ. 8. дБХФЕМХЕ Й ЛХМХЛСЛС Б ЛЕРНДЕ мЭЧРНМЮ.

|

мЮ ПХЯ. 8 ОНґЙЮґГЮґМЮ ЦЕНґЛЕґРґПХВЕЯґЙЮЪ ХМґРЕПґОПЕґРЮґЖХЪ СПЮБґМЕґМХЪ (12), МЮґЦКЪДґМН ДЕґЛНМґЯРґПХґПСґЧґЫЮЪ ПЮГґМХґЖС ЛЕґФґДС ЛЕґРНґДЮґЛХ ЦПЮґДХґЕМРґМНґЦН Х МЭЧґРНґМНБґЯЙНґЦН РХґОЮ. мЮґОПЮґБґКЕґМХЕ ЦПЮґДХґЕМґРЮ (ЮМХРґЦПЮґДХґЕМґРЮ), НРґБЕВЮЧґЫЕЕ МЮХґАНґКЕЕ ЙПСґРНґЛС ОНДЗґЕґЛС (ЯОСґЯґЙС) Б РНВЙЕ МЮВЮКЭґМНґЦН ОПХґАКХґФЕґМХЪ НОґПЕґДЕґКЪґЕРґЯЪ КНґЙЮКЭґМНИ ЙНМґТХґЦСґПЮґЖХґЕИ ОНґБЕПУґМНґЯРХ Х, ЙЮЙ ОПЮґБХґКН, МЕ ЯНБґОЮґДЮґЕР Я МЮґОПЮґБґКЕґМХґЕЛ Й РНВЙЕ ЩЙЯґРПЕґЛСґЛЮ. оНґЩґРНґЛС РПЮґЕґЙґРНґПХЪ ДБХґФЕґМХЪ Й ЛХґМХґЛСґЛС Б ЦПЮґДХґЕМРґМШУ ЛЕґРНґДЮУ ОПЕДґЯРЮґБґКЪґЕР ЯНґАНИ ГХЦґГЮґЦНґНАґПЮГґМСЧ КНґЛЮґМСЧ КХґМХЧ (ЯЛ. ПХЯ. 7). пЕґГСКЭґРЮР СЛґМНґФЕґМХЪ МЮ ЛЮґРґПХґЖС Б НАґЫЕЛ ЯКСВЮЕ ЛНґФЕР АШРЭ ОПЕДґЯРЮґБґКЕМ ЙЮЙ ЙНЛґАХґМЮґЖХЪ ОНґБНґПНґРЮ Х ХГґЛЕґМЕґМХЪ ЛЮЯґЬРЮґАЮ (ПЮЯґРЪґФЕґМХЪ ХКХ ЯФЮґРХЪ) БЕґЙґРНґПЮ. йЮЙ БХДґМН ХГ ПХЯ. 8, СЛґМНґФЕґМХЕ БЕґЙґРНґПЮ ЮМґРХґЦПЮґДХґЕМґРЮ МЮ ЛЮґРґПХґЖС H-1 НАЕЯґОЕВХБЮґЕР ЕЦН ОНґБНґПНР Б ЯРНґПНґМС РНВЙХ ЛХґМХґЛСґЛЮ. мЕґРПСґДґМН ОНґЙЮґГЮРЭ, ВРН Б РНЛ ЯКСВЮЕ, ЙНґЦґДЮ F(x) ЪБґКЪґЕРґЯЪ ЙБЮґДґПЮґРХВМНИ ТСМЙґЖХґЕИ, БЕґЙґРНП Dx, БШВХЯґКЕМґМШИ ОН СПЮБґМЕґМХЧ (12), ОПХґБНґДХР ОПЪґЛН Б РНВЙС ЛХґМХґЛСґЛЮ, Р. Е. ДЮґЕР РНВМНЕ ПЕґЬЕґМХЕ ГЮ НДХМ ЬЮЦ. дКЪ ТСМЙґЖХХ ОПНґХГґБНКЭґМНґЦН БХґДЮ НДґМНґЦН ЬЮґЦЮ СФЕ МЕґДНґЯґРЮґРНВМН, МН ЯЙНґПНЯРЭ ОПХґАКХґФЕґМХЪ Й ЛХґМХґЛСґЛС АСґДЕР ЯСґЫЕґЯРґБЕМґМН БШґЬЕ, ВЕЛ ОПХ ЯОСґЯґЙЕ ОН ЮМґРХґЦПЮґДХґЕМґРС.

оНХЯЙ ОН ЯЮИРС: